ceux de Netflix 3 Problème corps a conquis le public avec ses mystères de science-fiction, personnages complexes, et des visuels surprenants. Si vous êtes toujours hanté par cette scène du canal de Panama-dans lequel un navire rempli de personnes est découpé en rubans –ou les paysages imprévisibles du monde du jeu VR, voici un aperçu derrière comment ils se sont réunis.

Dans cette bobine VFX fournie exclusivement à io9 par le VFX Scanline appartenant à Netflix, vous pouvez avoir un aperçu de la scène du canal de Panama, ainsi que deux séquences mémorables du monde VR : la déshydratation/réhydratation du « Follower » qui est constamment condamné par les choix faits dans le jeu, et la scène dans laquelle le monde perd la gravité et tout le monde commence à flotter dans le ciel. Regardez la vidéo ici !

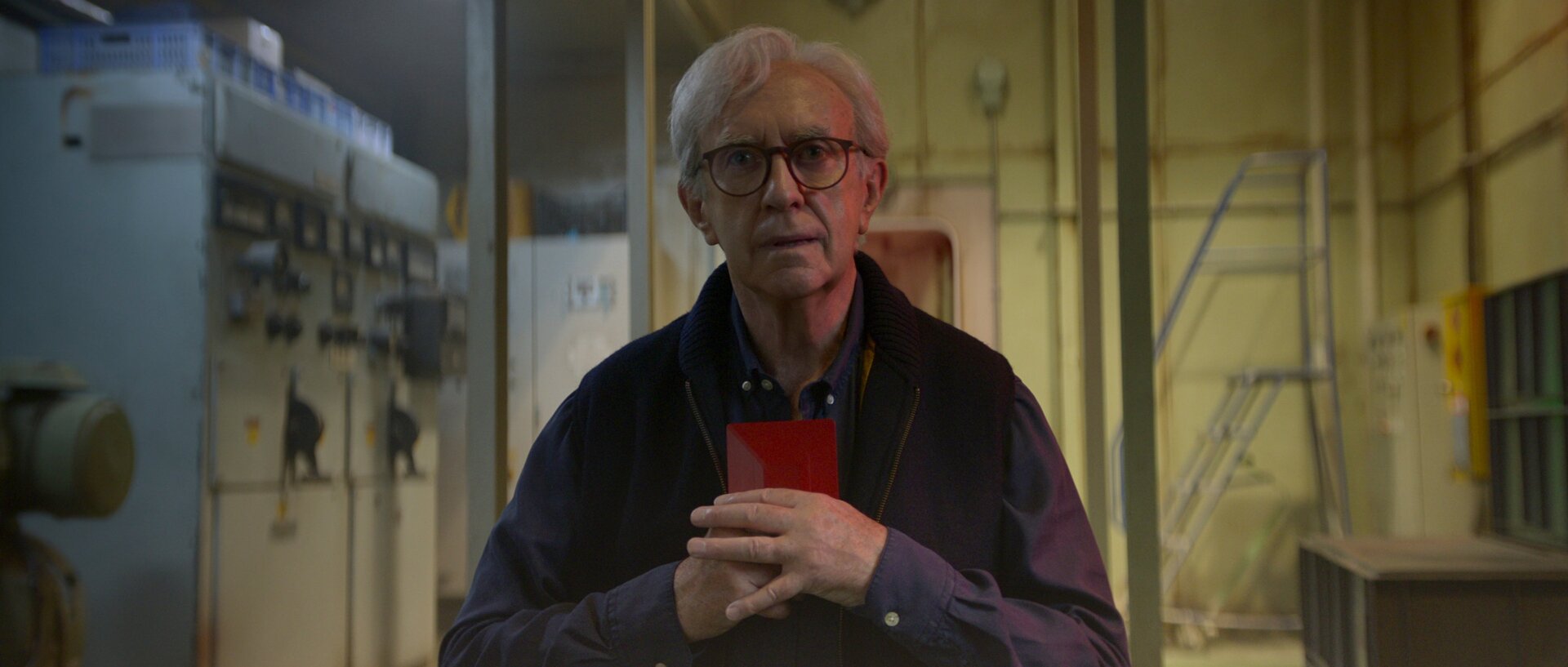

io9 a également eu la chance de discuter par e-mail avec l’un des deux superviseurs VFX chez Scanline qui ont travaillé sur ce projet, Boris Schmidt. . Il, avec Mathew Giampa, représentait à 3 Problème corpsLe superviseur général des effets visuels de Stefen Fangmeier et le producteur des effets visuels Steve Kullback, une réunion pour Scanline puisqu’ils ont également travaillé avec le même duo sur Jeu des Trônes.

Cheryl Eddy, io9 : Sur un projet comme 3 Problème corps, quelle part de ce que vous créez est tirée directement du scénario et quelle part est laissée ouverte aux interprétations artistiques ?

Boris Schmidt : Dans un projet comme 3 Problème corps, une partie importante de ce que nous créons est guidée par le scénario, garantissant que les éléments narratifs de cœur restent. Cependant, il y a une espace important pour l’interprétation artistique, en particulier dans les domaines où la narration visuelle et les effets spéciaux sont complexes et inhabituels.

Par exemple, le développement de la recherche des différents paysages massifs, en particulier dans la séquence accélérée de plusieurs millions d’années, s’est fortement appuyé sur l’art. direction et vision créative. Ces scènes ont permis la créativité dans les effets visuels, avec la flexibilité nécessaire pour capturer les qualités surnaturelles des paysages et Effets visuels.

De même, les effets entourant le processus de réhydratation et la représentation d’une fille en ruine et congelée (le personnage « Suiveur ») ont été soumis à interprétation artistique. Ces éléments visuels devaient évoquer l’émotion et la admiration, tout en adhérant au contexte récit et éditorial plus large. La direction artistique dans ces cas, il fallait un équilibre entre compétences techniques et imagination créatrice, permettant aux effets de compléter et d’améliorer le scénario sans le submerger.

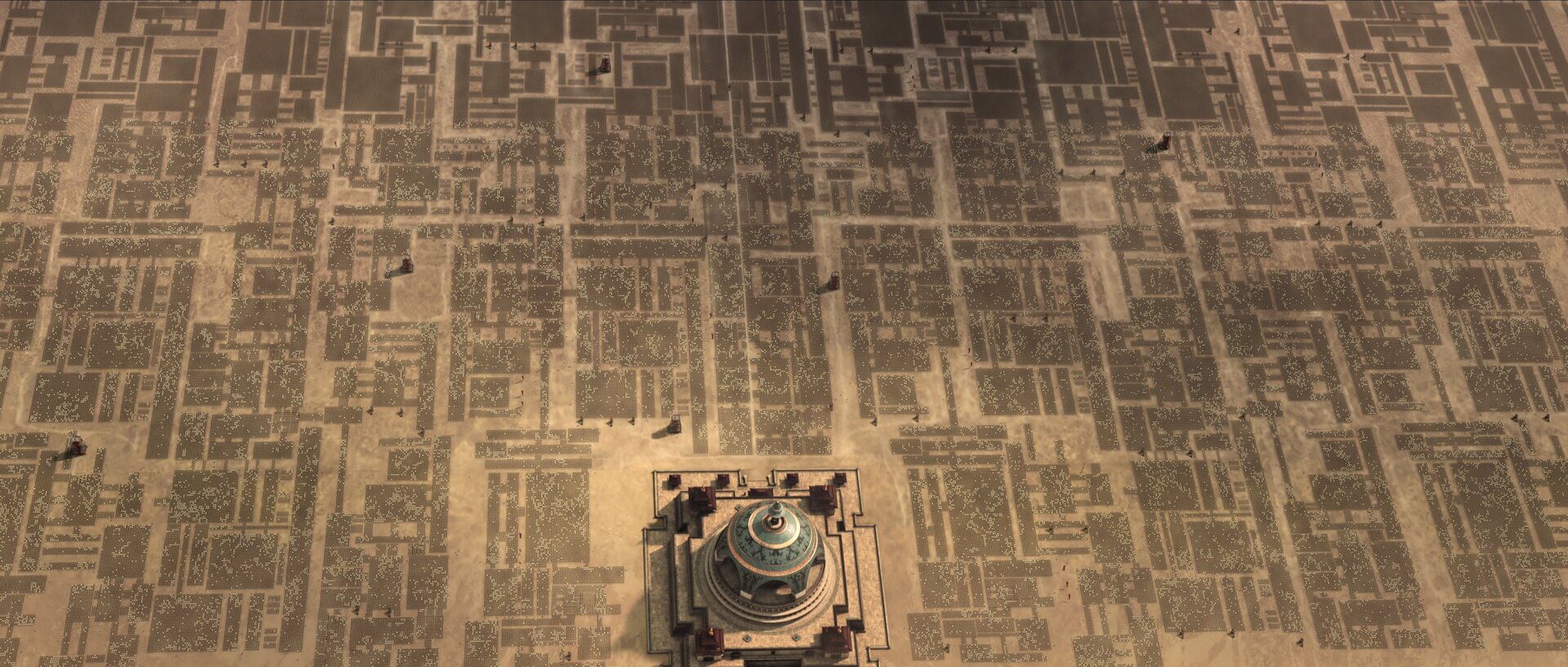

io9 : Quel a été votre point de départ lorsque vous concevez le monde dans le jeu VR ?

Schmidt : Lorsque nous concevions le monde dans le jeu VR, mon point de départ était une compréhension globale de la vision du client et du cœur du projet. concept. Le processus comportait plusieurs étapes clés :

1. Collaboration avec le client :

J’ai commencé par discuter avec le superviseur VFX du client, Stefen Fangmeier, pour comprendre ses attentes, son scénario, les mécanismes de jeu et sa vision esthétique. Ces discussions établir la base de l’ensemble du processus de conception.

2. Rassembler des concept arts et des références :

J’ai collecté et examiné tous les concepts artistiques, les storyboards ou les modifications préliminaires fournis par le client. Cela m’a aidé à comprendre le style visuel souhaité, la disposition de l’environnement et le ton général du monde du jeu. J’ai également rassemblé des images de référence sur Internet, en me concentrant sur des éléments comme l’architecture, les paysages, des textures et des palettes de couleurs pour élargir la portée créative. Dans certains cas, nous avons utilisé l’IA générative pour recueillir des références supplémentaires.

3. Analyse des fichiers prévis Unreal Game-Engine fournis :

Nous avons analysé les fichiers du moteur de jeu existants qui ont été utilisés pour créer l’aperçu, afin d’obtenir des informations sur la disposition de la scène et d’explorer différents angles de caméra.

4. Brainstorming et planification :

Après avoir collecté toutes les références et les informations nécessaires, j’ai entamé des séances de brainstorming avec les différents superviseurs et responsables du département. Cette phase impliquait des esquisses concepts initiaux, décrivant la disposition du monde du jeu et réfléchissant à la manière de construire ces mondes de manière créative et technique.

5. Créer l’environnement virtuel :

Une fois que nous avions un plan clair, nous avons commencé à construire les environnements virtuels. Cela impliquait la création d’environnements, de modèles 3D, de textures, d’éclairage et d’effets complexes. configurations, foules, etc. À partir de ce moment, nous avons continuellement affiné la conception grâce à des réunions d’examen itératives et aux commentaires des clients.

io9 : Le monde du jeu VR est principalement constitué de paysages et de foules massifs, mais il y a aussi des moments de proximité et d’intimité, y compris le “déshydratation”. » et une séquence « réhydratante » vue dans la bobine. Comment avez-vous abordé la création de cette série d’effets particulière ?

Schmidt : L’effet a nécessité d’importantes recherches et développements, mais après avoir examiné différentes méthodes, nous avons choisi l’approche suivante :

Tout d’abord, nous avons construit un squelette interne pour le personnage principal afin qu’il puisse agir comme un collisionneur pour le maillage extérieur de la peau. le squelette et la peau extérieure étaient tous deux contrôlés par la même plate-forme d’animation, nous pouvions donc les poser et les animer à l’aide d’outils d’animation classiques. Nous avons utilisé la simulation de tissu Vellum de Houdini pour aplatir la peau et les os, puis les avons enroulés avec une autre simulation de plate-forme et de tissu. nous avons enroulé le personnage lui-même pour permettre un effet de déroulement coordonné. Nous avons contrôlé le timing de ces simulations avec des dégradés et des bruits 3D. pour avoir une direction artistique plus précise.

Les os et la peau ont été gonflés par un ensemble de dégradés 3D, ce qui nous permet d’ajuster le timing pour les deux séparément. Ces dégradés également nous a aidé à faire la transition entre trois nuances de surface différentes : une qui donnait à la peau un aspect sec et coriace, une autre qui lui donnait un effet translucide, et un shader final pour la peau humaine. Les transitions de shader étaient basées sur la courbure de la surface et les attributs de simulation. Nous avons utilisé une contrainte carte qui montrait où la peau du personnage était étirée ou compressée pour créer des effets supplémentaires. Nous avons également utilisé une carte de courbure pour déterminer la forme concave. et des zones convexes, qui ont aidé à ajouter des détails fins et une texture supplémentaire à la surface.

Les cheveux ont été simulés séparément, avec des splines de guidage créées dans Houdini, puis transférés vers Maya. Nous avons décidé de restituer toutes les variations de shader et les transitions sont séparées pour donner un contrôle total sur la composition. Cela s’est fait au prix de temps de rendu importants, y compris le superbe aspect translucide, où vous peut toujours voir le squelette interne.

Ensuite, nous avons affiné les résultats en effectuant des ajustements et en supprimant tous les artefacts indésirables à l’aide de la modélisation de tir au-dessus des caches finales de l’Alambic. FX a fourni des simulations d’aération supplémentaires et des bulles d’air émises par le personnage. Comme toujours, le look final a été composé en ajoutant du compositing. amour.

io9 : Le monde de la réalité virtuelle éprouve également, à un instant un instant une perte totale de gravité. Quelles références aviez-vous pour le mouvement dans cette scène, qui est un mélange de terrifiant et de gracieux ?

Schmidt : Nous avons examiné des références en apesanteur provenant de la station spatiale internationale et des images d’avions à gravité réduite (surnom de comète vomi). Plus des références sous-marines supplémentaires Nous avons collecté pour la scène de réhydratation qui comportait également des éléments d’apesanteur flottante. Nous avons analysé de près la longueur des cheveux qui se déplacent dans l’espace. et sous l’eau pour le personnage de petite fille nommé « la suiveuse ». Nous avons décidé d’opter pour le look sous-marin, car la référence à l’espace se faisait sentir. trop rigide et ennuyeux par rapport au mouvement sous-marin.

Pour les personnages au premier plan, nous avons décidé d’utiliser des personnages entièrement animés, y compris les chevaux, afin d’avoir plus de contrôle et de rester flexible pour répondre aux notes. Notre équipe d’animation a trouvé d’excellentes idées pour les mouvements du cheval en apesanteur, par exemple donner des coups de pied avec les sabots et en tournant la tête, pour montrer la panique de l’animal dans cette situation peu courante.

Pour les personnages au milieu du plan et à distance, nous avons utilisé un mélange de personnages animés, capturés par le mouvement et simulés par un ragdoll. Notre équipe de capture de mouvement a réalisé une excellent travail en suspendant les artistes sur des câbles pour aider à la sensation d’antigravité. Notre équipe FX a simulé tous les actifs non vivants comme les tours en désintégration, les tuiles flottantes, les bannières et les drapeaux flottants, etc. Notre équipe FX a eu le grand défi de piloter le mouvement global de ces millions de personnages et d’actifs avec des simulations de particules et de physique.

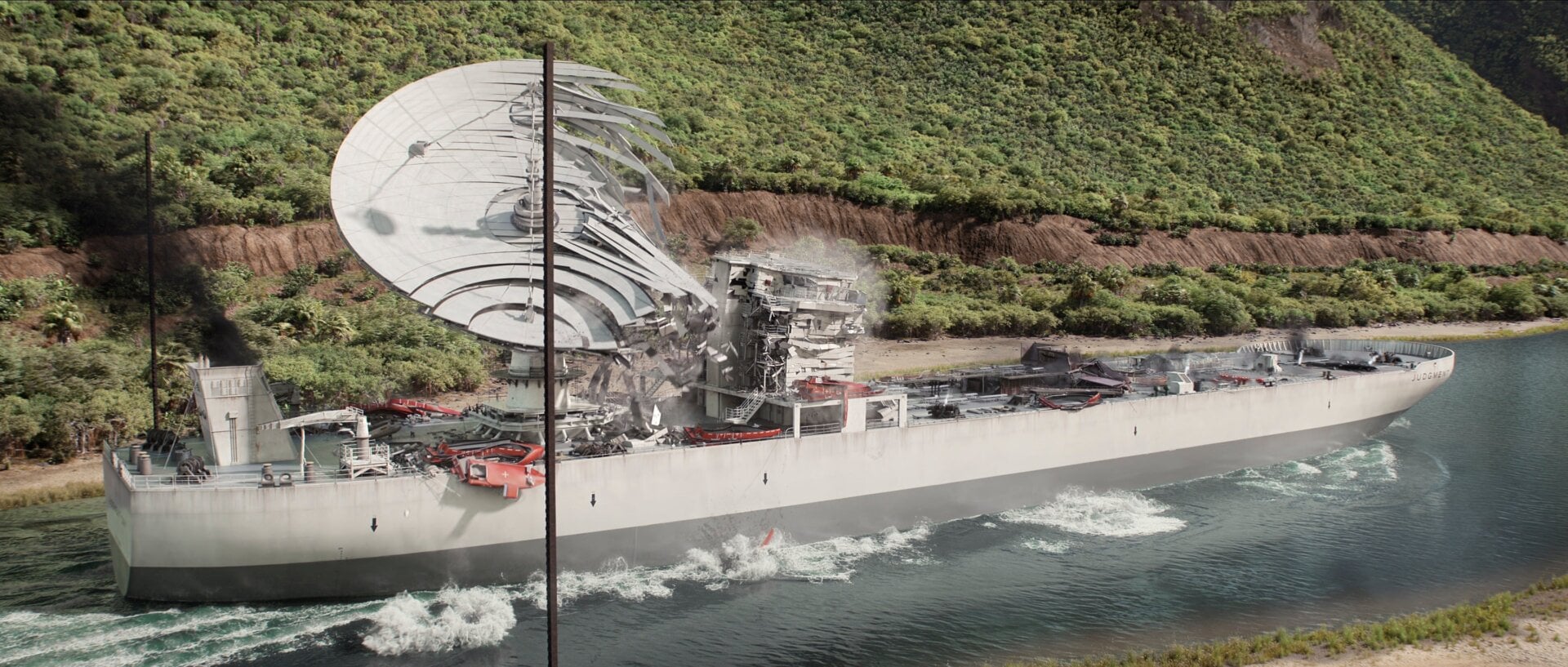

io9 : Le Jour du jugement La séquence est probablement le moment le plus mémorable de toute la série : elle est tellement choquante et a un énorme impact visuel. prendre en considération, pour que cela paraisse aussi réaliste que possible ?

Schmidt : À ce stade, je souhaite accorder une reconnaissance particulière au co-superviseur des effets visuels Mathew Giampa pour sa contribution exceptionnelle à la séquence Tanker. L’expertise de Mathew et sa vision créative ont été cruciaux pour obtenir des résultats aussi impressionnants. Le réalisme de la séquence a été obtenu grâce à une combinaison d’éléments. sont quelques éléments clés qui étaient essentiels.

Tout d’abord, nous devions construire une représentation numérique complète du canal de Panama, en nous concentrant sur la manière de la rendre aussi réaliste que possible. Notre référence était la section Culebra Cut du canal, connue pour ses caractéristiques de terrasse distinctes. Cela impliquait la création d’une variété d’arbres et de plantes indigènes. dans cette région, en créant efficacement un environnement photoréel entièrement généré par ordinateur à partir de la base.

Nous avons également assumé la tâche de construire et d’aider à concevoir le citerne nommé Jour du jugement. Cela nous obligeait à faire adapter la disposition du pont à l’ensemble pratique, en s’assurant que chaque détail correspondait avec précision. Cela incluait divers actifs, comme le terrain de basket-ball, l’hélicoptère et la piste d’atterrissage, qui devaient être placés précisément sur le pont.

L’un des aspects difficiles était d’illustrer les nano filaments, qui fonctionnent à une échelle atomique. Les coupes qu’ils produits ne sont visibles quand les pièces commencent à glisser. Représenter cet effet à la fois sur le pétrolier et sur les gens représentait un défi visuel, car il n’y avait pas de véritables pièces. exemples du monde dont s’inspirer. Notre équipe FX a dû décrire de de manière convaincante l’ampleur de ces tranches et le poids des composants individuels et comment ils pourraient interagir physiquement.

Nos équipes de développement du look et d’éclairage ont joué un rôle crucial en reliant tout ensemble. Ils ont travaillé pour s’assurer que l’éclairage et les shaders étaient cohérents. à travers l’environnement, les simulations de tankers et d’effets lourds.

io9 : Quel a été le plus grand défi auquel vous avez été confronté en travaillant sur cette escalade où tout à travers le navire était coupé en morceaux ?

Schmidt : Concevoir des configurations d’effets complexes pour une scène de découpage de navire implique d’orchestrer une symphonie d’effets qui doivent fonctionner à l’unisson. Cela englobe plusieurs éléments physiques. simulations, y compris la division dramatique du navire lui-même, le mouvement tourbillonnant de l’eau du canal et l’éruption du sol sur le rivage comme Le navire et les débris s’écrasent sur la terre.

À côté de ces éléments plus gros se trouvent de fines particules de poussière soulevées par l’impact et des objets qui tombent et entrent en collision sur le pont du navire. ainsi que le découpage simulé de figures humaines, de petits fragments dispersés dans l’air et des vagues de pulvérisation d’eau frappant les environs. , des nuages de fumée, des étincelles volent et des explosions occasionnelles éclatent alors que le navire est déchiré.

La coordination de cette gamme complexe d’effets nécessite une attention méticuleuse aux détails pour assurer la continuité des effets sur plusieurs plans et dans différents départements. Le composant doit être soigneusement dirigé artistiquement afin que la séquence maintienne un flux transparent du début à la fin, avec tous les différents éléments parfaitement. alignés et synchronisés. Félicitations à notre équipe FX et à tous les autres départements qui ont créé cette superbe séquence.

io9 : Quelle séquence a pris le plus de temps ou le plus de travail à réaliser, et pourquoi ?

Schmidt : Certes, le Jour du jugement La séquence a nécessité un temps considérable à produire pour les raisons détaillées dans la réponse précédente. D’autres scènes ont également exigé des périodes de développement prolongées. Par exemple , la scène de gravité inversée mettant en présent une armée flottante a pris un certain temps car elle impliquait de nombreux types de tir uniques, comme la simulation d’apesanteur de l’eau. De plus, il y avait le défi de créer le calculateur humain. La scène horrible où Turing et Newton sont découpés par Khan était requise. une attention précise aux détails. De même, la séquence time-lapse CGI complète avec des installations de lumière animées et des nuages , ajoutées au long développement processus.

Vous pouvez regarder 3 Problème corps sur Netflix.

Vous voulez plus d’actualités sur io9 ? Découvrez quand attendre les dernières merveille, Guerres des étoiles, et Star Trek sorties, quelle est la prochaine étape pour DC Univers au ciné et à la télé, et tout que vous devez savoir sur l’avenir de Docteur Who.